Cos'è la GEO (Generative Engine Optimization)

Perché questo articolo è utile a chi possiede — o sta pensando di creare — un sito web?

Probabilmente se sei in questa pagina, ti sei chiesto almeno una delle domande che trovi qui sotto.

Cos'è la SEO e perché esiste?

A chi è rivolto questo articolo

Questo articolo è diviso in quattro sezioni, pensate per quattro tipi di lettori diversi.

Puoi leggerlo dall’inizio alla fine oppure saltare direttamente alla parte che ti riguarda.

- Sezione 1 — Vuoi capire come è nata la SEO e perché esiste? Inizia da qui.

- Sezione 2 — Hai un sito web ma la tecnologia non è il tuo forte? Questa sezione è scritta per te.

- Sezione 3 — Sei un utente intermedio o un web designer agli inizi? Troverai concetti pratici e subito applicabili.

- Sezione 4 — Lavori già con JSON-LD, dati strutturati e architetture avanzate? Vai direttamente all’ultima parte.

Inizierò con una breve storia di come è nata la necessità di creare la SEO e perché Google ha continuato ad aggiungere nuove regole per aumentare le probabilità che il sistema consideri i siti affidabili nel processo di ranking.

Nella seconda sezione parlerò a chi, quando si tratta di tecnologia, è come imparare l'arabo — ma nonostante questo ha bisogno di conoscere le basi, perché ha un sito web e vuole che abbia successo per la sua azienda. Mi limiterò a esempi semplicissimi per aiutarli a capire quello che serve davvero.

Se invece sei un utente intermedio o un web designer alle prime armi, puoi spostarti alla terza sezione, dove spiego in modo più dettagliato l'importanza della E-E-A-T quando si crea un sito e come si può raggiungere con una buona SEO abbinata a degli schema di dati strutturati — anche tramite plugin, se non sei ancora in grado di scriverli a mano.

Infine, se sei un collega esperto che scrive i propri JSON-LD a mano o li genera in modo dinamico tramite PHP, puoi saltare direttamente alla quarta sezione, dove troverai un linguaggio più tecnico che ti aiuterà a capire dove sta andando la SEO del futuro con l'implementazione degli attributi per le AI.

Chi sta scrivendo?

Prima di spiegarvi come è nata la SEO e perché si è evoluta, lasciate che mi presenti brevemente.

Mi chiamo Roberto Bianchi e già nel 1997 ero uno dei primi al mondo a usare JavaScript per dare vita ai siti web. All'epoca vivevo in Finlandia.

Il mio sito accattivante dell'epoca ha destato l'attenzione della KONE OY (diventata KONE Corporation nel 2005), che mi ha offerto una posizione come responsabile della intranet mondiale dell'azienda — all'epoca collegata a diverse migliaia di terminali in tutto il mondo.

In breve sono diventato amministratore del sistema che l'azienda usava per gestire i disegni industriali.

Allo stesso tempo sono diventato anche formatore interno. Tra il 1998 e il 2002 ho girato il mondo per la KONE: Italia, Francia, Finlandia e USA.

Da qualche anno vivo di nuovo in Italia:

- Nel 2022 ho ottenuto la certificazione come insegnante TEFL OFQUAL di livello 5

- Nel 2024 ho aperto la mia ditta Global Digital Web di Roberto Bianchi — offro consulenze, creo siti web (solo per clienti che seleziono accuratamente) e insegno tecnologia in lingua inglese per il progetto Erasmus+ dell'Unione Europea

Pezzi di carta a parte, la tecnologia è sempre stata la mia passione. E mi sento di poter dare qualche dritta a chi vuole saperne di più.

La storia della SEO

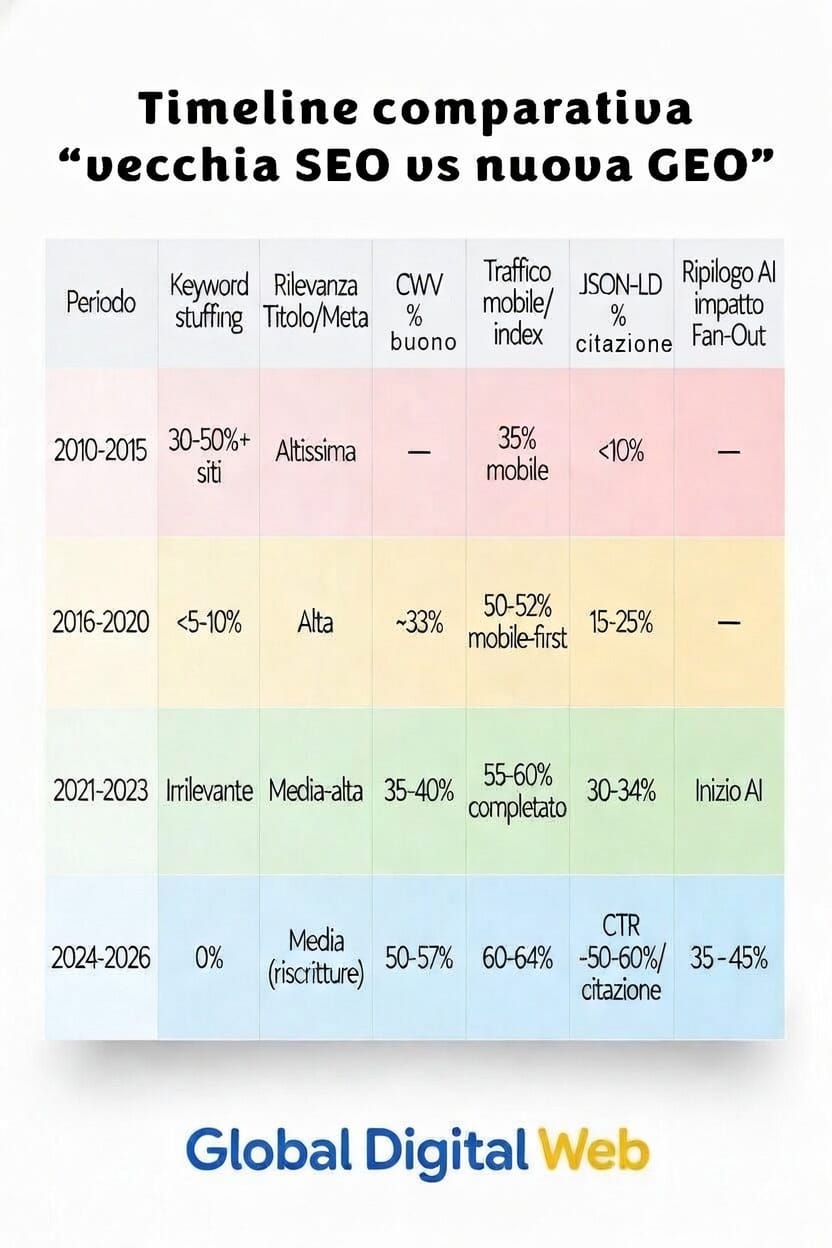

Negli anni ’90 bastavano trucchi banali per ingannare i motori di ricerca. Oggi Google premia chi dimostra competenza reale, affidabilità e utilità concreta.

In questa sezione ripercorro oltre 25 anni di evoluzione della SEO: dal testo bianco su sfondo bianco agli aggiornamenti che hanno portato al concetto di E-E-A-T, raccontati dal punto di vista di chi ha vissuto queste trasformazioni in prima persona.

Il mondo prima di Google: Altavista e Netscape

Partiamo dal 1997, quando Google ancora non esisteva.

In quegli anni il panorama di internet era molto diverso da oggi:

- Il motore di ricerca per eccellenza si chiamava Altavista

- Il browser più amato si chiamava Netscape

- Le pagine web venivano scritte solo a mano — niente drag and drop (tira e rilascia)

Nel frattempo, tra il 1996 e il 1997, due ragazzi stavano mettendo le radici di quello che sarebbe diventato il motore di ricerca più potente della storia: Larry Page e Sergey Brin, che lo stavano costruendo a Stanford.

La nascita della SEO: come tutto è cominciato

Proprio nel 1997 qualcuno coniò il termine SEO — era come dire "impariamo a far vedere meglio il nostro sito quando la gente cerca qualcosa".

(fonte: Storia della SEO dalla nascita di Google all'era dell'AI)

Per farsi trovare su Altavista c'erano diversi trucchetti. Il più diffuso era scrivere le parole chiave più importanti anche 1.000 o 2.000 volte, con testo bianco su sfondo bianco, ridotto a 1 pixel di grandezza. Immagina di scrivere il nome del tuo negozio mille volte su un foglio bianco con un pennarello bianco. Chi entra nel negozio non vede nulla — ma il sistema di classificazione sì, e ti metteva in cima alla lista. Chi visitava il sito non vedeva nulla. Ma Altavista ti metteva al primo posto.

Attenzione! Questi erano trucchetti di 30 anni fa. Oggi sono considerati pratiche scorrette e vengono penalizzati.

Nel 1998, mentre lavoravo in KONE, ricordo ancora il mio collega Jorma Heimonen — all'epoca il genio per eccellenza — che mi disse:

"Roberto, hai provato a usare Google invece di Altavista? Lo sai che ti danno anche la casella di posta gratuita?"

Quella casella di posta la uso ancora oggi.

Qui una schermata di Google nel 1999 quando era ancora in fase BETA.

I primi "blocchi stradali" di Google: basta fare i furbi

Google cresceva in fretta. Il 16 novembre 2003 arrivò il primo grande aggiornamento.

Una cosa utile da sapere: Google ha l'abitudine di dare nomi in codice ai suoi aggiornamenti — spesso nomi di animali, luoghi o stagioni. Un po' come i meteorologi fanno con gli uragani. Ogni volta che sentirete uno di questi nomi, sapete che Google ha cambiato le regole del gioco.

Il primo si chiamò Florida, e il messaggio era chiaro: "Basta fare i furbi!" Tutti i siti che usavano i vecchi trucchi sparirono dalla prima pagina.

Fu uno shock: tanti webmaster si svegliarono con il sito scomparso nel nulla.

La risposta di molti? Spostare le parole chiave nei metadati — una specie di etichetta invisibile nell'intestazione della pagina, che chi naviga non vede mai ma i motori di ricerca leggono eccome. L'idea era: "Se le nascondo meglio, funzionerà lo stesso."

Ma anche lì si esagerò con il cosiddetto keyword stuffing — riempire queste etichette di parole chiave ripetute all'infinito.

Immagina di aprire un menù di ristorante e trovare scritto "pizza" quattrocento volte. Capiresti subito che c'è qualcosa che non va — e Google ha imparato a capirlo anche lui.

Nel settembre 2009 Google chiuse definitivamente quel capitolo: «Non usiamo più i meta keywords per il ranking: li ignoriamo da anni perché abusati.»

(fonte: Google non usa il meta tag keywords) E Google non si fermò qui.

Panda, Hummingbird e gli anni della qualità

Nel febbraio 2011 arrivò Panda — un filtro che non aveva pietà per i siti con articoli corti, copiati o scritti solo per fare pubblicità. Voleva contenuti veri, utili, belli da leggere.

Pensa a Panda come a un ispettore di salute nei ristoranti: chi serviva cibo scadente veniva chiuso. Chi cucinava bene veniva validato.

Chi gestiva "fabbriche di contenuti spazzatura" perse posizioni a valanga.

Ma questo per Google non bastava e cosi nel settembre 2013 arrivò Hummingbird — in italiano, il colibrì. Con questo aggiornamento Google smise di cercare parole isolate e iniziò a capire il senso della domanda.

Prima era come un bibliotecario che cercava libri solo per titolo esatto. Dopo Hummingbird era come un bibliotecario che capisce cosa vuoi davvero leggere.

In pratica: finalmente potevi parlare a Google come parleresti a una persona, non come quando compili un modulo.

Un dettaglio curioso: Hummingbird era già attivo in silenzio dal 20 agosto, ma Google lo annunciò ufficialmente solo un mese dopo — e nel frattempo nessuno se n'era accorto.

Se cercavi "come fare una torta al cioccolato soffice", non ti restituiva più liste di ingredienti a caso: capiva che volevi una ricetta buona e facile. Da lì nacque l'importanza di scrivere frasi complete, naturali, con i titoli in ordine logico.

E mentre tutti si affrettavano ad adeguarsi, Google stava già preparando la prossima mossa. (fonte: Google Hummingbird)

2015: arriva il Mobilegeddon — il tuo sito si vede sul cellulare?

Il 21 aprile 2015 arrivò uno dei cambiamenti più importanti nella storia della SEO: il famoso Mobilegeddon.

Google decretò che un sito deve essere comodo e utilizzabile anche — e soprattutto — sul telefono. Se aprivi un sito da cellulare e trovavi testi minuscoli o pagine lente, Google riduceva drasticamente la visibilità nei risultati.

Era come se il comune decidesse che tutti i negozi devono avere una porta abbastanza larga per le sedie a rotelle. Chi non si adeguava perdeva clienti — e Google li faceva retrocedere nelle classifiche.

Hai mai sentito la parola "responsive"? Significa un sito che si adatta perfettamente a telefonini, tablet e PC, come nell'esempio in foto.

Oggi un sito non responsive indica competenze non allineate agli standard minimi del web moderno. Occhio ai cuggini che fanno siti per 300€ che Google poi penalizza.

Risolto il problema dei cellulari, Google si pose una domanda ancora più difficile: "Ok, il sito si vede bene sul telefono — ma chi lo ha scritto sa davvero di cosa parla?"

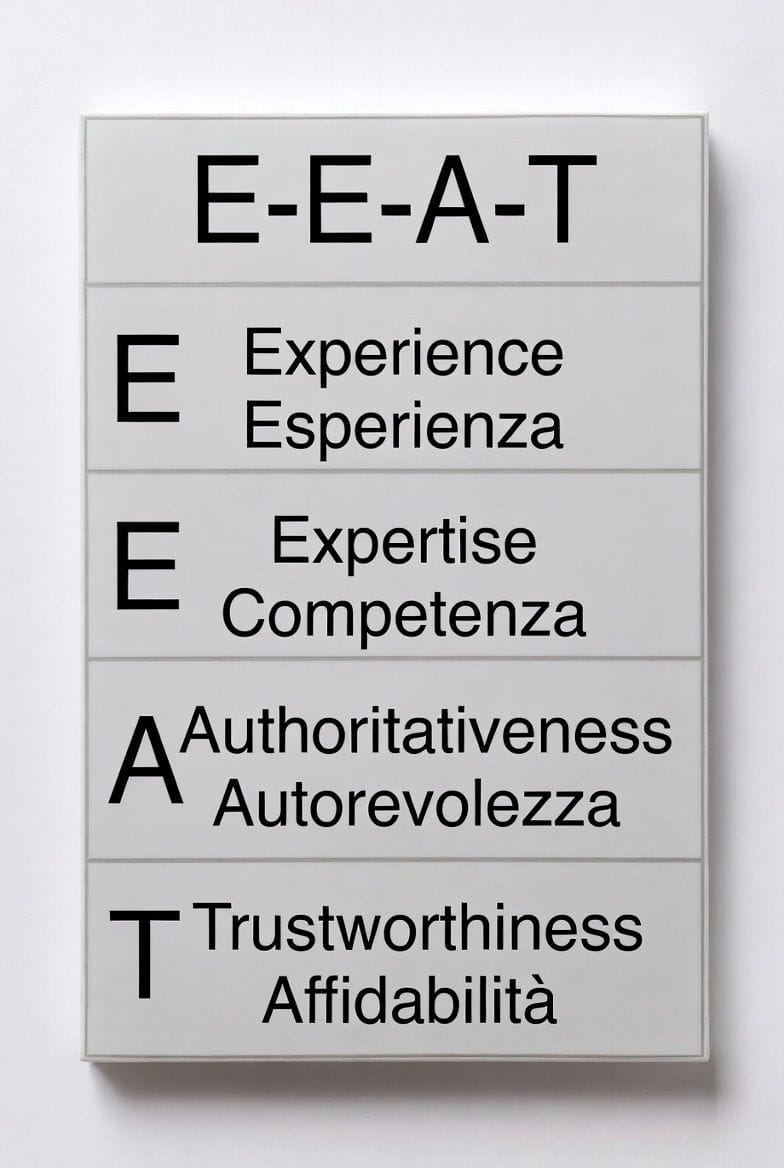

E-E-A-T e Helpful Content: A Google piacciono i professionisti che sanno davvero di cosa parlano

Nell'agosto 2018 arrivò un aggiornamento soprannominato Medic Update — così chiamato perché colpì duramente i siti medici e di salute che davano consigli senza avere le competenze per farlo.

Fu il momento in cui Google cominciò a considerare più affidabile chi dimostrava di essere un vero esperto. Quel concetto oggi ha un nome: E-E-A-T. Pensa a quando cerchi un medico. Non ti fidi del primo che passa per strada — vuoi sapere dove ha studiato, quanti anni di esperienza ha, cosa dicono gli altri pazienti.

Google ragiona allo stesso modo con i siti web.

| Lettera | Significato | In parole semplici |

| E | Experience — Esperienza | Hai vissuto in prima persona quello di cui parli? |

| E | Expertise — Competenza | Sei davvero preparato sull'argomento? |

| A | Authoritativeness — Autorevolezza | Gli altri ti riconoscono come esperto? |

| T | Trustworthiness — Affidabilità | Ci si può fidare di quello che scrivi? |

La sigla completa con la doppia E è arrivata nel dicembre 2022, ma l'idea era già lì dal 2018 — e Google ci lavorava in silenzio nelle sue linee guida interne già dal 2014.

Morale della favola

Hai capito perché esiste la SEO? Da un lato spinge a produrre contenuti sempre più di qualità. Dall'altro serve a "sgamare" chi sfrutta le AI per creare siti copia-incolla al volo, convinto di essere un webmaster.

Nel 1997 potevi imbrogliare con trucchi da quattro soldi. Oggi no. Niente più scorciatoie.

Cosa riserva il prossimo futuro? Ne parlo qui sotto — in versione semplice, intermedia o per colleghi esperti.

Per chi non è ferrato in tecnologia: cos’è la GEO e perché cambia il futuro delle ricerche

Ma prima… la usavi già senza saperlo

"Siri, dove trovo un ristorante di pesce qui vicino che abbia buone recensioni?" "Hey Google, quali sono le farmacie di turno aperte a quest'ora?"

Ricordate la prima volta che avete fatto una domanda del genere?

Anche se l'intelligenza artificiale è esplosa al grande pubblico tra la fine del 2022 e il 2023 con ChatGPT, la utilizzavamo già da anni senza saperlo.

Perché questo è importante per chi ha un'attività e vuole un sito web che funzioni davvero? Perché il modo in cui un tempo venivano trovati i siti web era semplice: scrivi un titolo, dei sottotitoli e dei testi, e i motori di ricerca come Google e Bing decidevano chi aveva la risposta migliore. Ma le cose sono cambiate drasticamente.

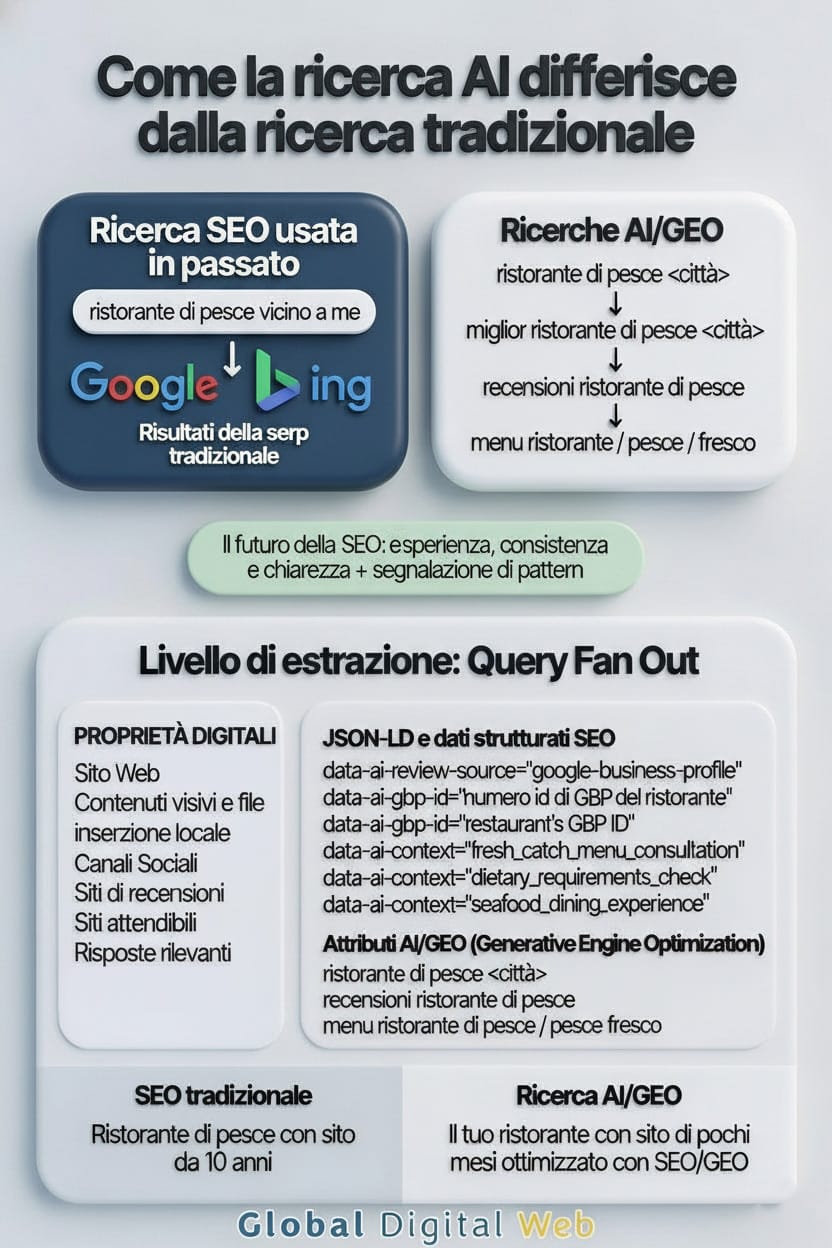

Un esempio concreto: il ristorante di pesce

Torniamo alla domanda di prima: "Siri, dove trovo un ristorante di pesce qui vicino che abbia buone recensioni?"

Le persone non cercano più su Google come una volta. Si affidano sempre più all'intelligenza artificiale per decidere dove andare, cosa comprare e di chi fidarsi.

(fonte: Dalla SEO alla GEO: come l'intelligenza artificiale ti cambia la SERP — Ovunque.it)

Per rispondere a una domanda come questa, non basta che chi ha fatto il sito del ristorante abbia caricato il menu online. L'AI deve capire che il menu ha buoni piatti di pesce. Deve sapere quali sono i piatti preferiti dai clienti. Deve poter confrontare le recensioni vere.

Pensa all'AI come a un consulente personale che conosce tutti i ristoranti della città. Se vuole consigliarti bene, ha bisogno di informazioni dettagliate e affidabili — non di un cartello con scritto solo "ristorante di pesce".

Chi crea il sito deve sapere collegarlo al profilo Google Business Profile del ristorante, o al suo account Yelp o TripAdvisor, in modo che sul sito appaiano le recensioni vere dei clienti. Così le AI possono incrociare le informazioni e capire di chi fidarsi.

Se i dati sono precisi e scritti nel modo giusto, invece di controllare centinaia di risultati, l'AI userà le informazioni del sito più autorevole — quello che parla la sua lingua.

Il risultato: il nuovo batte il vecchio

In passato Google metteva al primo posto il ristorante che aveva il sito da più anni e un traffico decente.

Oggi le persone si aspettano la risposta direttamente dall'AI. Facciamo un esempio. Un ristorante di pesce nuovo chiamato "Da Mario", aperto da soli 6 mesi, ha un sito ricco di informazioni strutturate:

- Chi è lo chef, quanta esperienza ha, dove ha studiato e lavorato

- Se ha vinto premi o riconoscimenti

- Le recensioni vere dei clienti

- Il collegamento al profilo Google Business Profile

L'AI controlla questi dati, verifica che siano affidabili e risponde:

"Se vuoi mangiare buon pesce vai al ristorante 'Da Mario' — lo chef ha molta esperienza e le recensioni sono ottime. Lo trovi in via… Questo è il menu… questo è il numero per prenotare."

Un ristorante con un sito generico e privo di dati strutturati parte fortemente svantaggiato rispetto a chi rende le proprie informazioni verificabili.

Google non vuole solo promesse

Scrivere queste informazioni sul sito non basta. Google vuole segnali verificabili, coerenti e confrontabili.

Queste vanno inserite da uno sviluppatore esperto che usa tecnologie specifiche — come i JSON-LD — per comunicare con Google in modo strutturato. Se i dati sono veritieri e facilmente incrociabili, aumentano le probabilità che il sistema li consideri affidabili nel processo di ranking.

È come la differenza tra dire "sono un bravo cuoco" e mostrare il diploma di una scuola di cucina, le recensioni dei clienti e le foto dei piatti. Le parole da sole non bastano — servono le prove.

Chi usa queste tecnologie parte con un vantaggio competitivo rispetto a chi utilizza un sito privo di dati strutturati avanzati.

(fonte: Cos'è la GEO e come si differenzia dalla SEO — Brainpull.com)

Ma non voglio dare false speranze. Questo è un buon inizio — per arrivare e mantenere le prime posizioni, però, occorre anche un piano editoriale e una pubblicazione costante, che dimostri nel tempo di essere in grado di aiutare le persone.

La scorciatoia esiste — ma costa

Si chiamano Ads.

In pratica dici a Google o a un altro servizio pubblicitario: "Quando una persona con queste caratteristiche, di questa fascia d'età, che vive in questa zona fa questo tipo di ricerca, metti il mio sito in cima."

Quando arriva quella persona, Google mette il tuo sito tra i primi risultati con la scritta "Sponsorizzato" accanto — per avvertire che si tratta di pubblicità.

Funziona così:

- Se la persona non clicca sul tuo sito, non paghi nulla

- Se la persona clicca, paghi una cifra che dipende dalla popolarità di quella parola chiave

- Paghi sia che diventi un cliente, sia che se ne vada senza fare nulla

Il costo varia molto. Per alcune parole chiave Google prende uno o due euro a click. Per altre molto gettonate il costo esplode.

La parola "Rolex", per esempio: ogni volta che qualcuno clicca su un risultato sponsorizzato che usa quella parola, il proprietario del sito brucia decine di euro — anche se non avviene nessuna vendita.

C'è un altro problema: una volta esaurito il budget, la visibilità sparisce quasi subito. Il sito torna a scendere come se le ads non fossero mai esistite.

Allora conviene fare le Ads?

Personalmente, per un sito appena nato, direi "ni".

Se il sito è fatto a regola d'arte Google può indicizzarti anche il giorno dopo e farti già trovare tra i risultati. Ma c'è una cosa da sapere:

- Quei primi risultati sono basati solo sui testi visibili — quello che leggi sulla pagina

- Non sono ancora basati sui dati e sui codici scritti appositamente per Google

Per un sito nuovo, nei primi 2-4 mesi ci saranno alti e bassi nella posizione, finché Google non avrà mandato i suoi programmi a esaminare il codice del sito.

Immagina Google come un ispettore comunale che deve visitare il tuo negozio prima di metterti sulla mappa ufficiale. Ci vuole un po' di tempo, ma quando arriva, se trova tutto in ordine, ti promuove.

Quello è il momento migliore per investire qualche centinaio di euro in pubblicità. Google vede che le persone entrano nel sito, inizia a considerarlo affidabile — e anche quando il budget delle ads finisce, tende a mantenerti in alto. Ma solo se continuate a svilupparlo.

I siti su Google sono come una vasca piena di pescecani. Se smetti di muoverti, qualcuno più grosso arriva e ti scalza.

Per capire come evitarlo e come sfruttare al meglio queste tecnologie, passiamo alla sezione intermedia — per chi ha già dimestichezza con la creazione di siti web e vuole capire come usare la GEO a proprio vantaggio.

Oltre il biglietto da visita virtuale: per utenti intermedi e web designer

I plugin SEO non bastano più. Un sito professionale oggi deve parlare la lingua delle AI, avere dati strutturati verificabili, essere veloce, accessibile e coerente con tutte le sue identità digitali.

Il plugin SEO non ti salva

Se hai un sito in WordPress, probabilmente pensi che basti installare un plugin SEO come Yoast o RankMath per essere "a posto". Non è così.

Molti siti con effetto WOW e una SEO fatta solo con plugin sono spesso un costoso biglietto da visita virtuale che vedranno in pochi. O nessuno.

Come ragiona davvero l'AI quando cerca informazioni

Guardando il processo di ricerca AI, noterai che non si tratta di una ricerca semplice. Quando una ricerca è complessa, Google non la tratta come una singola frase. La scompone, analizza le entità coinvolte e incrocia più fonti per costruire una risposta coerente.

(fonte: Query Fan-Out: come l'AI spezzetta le query — DeepSEO.it)

Come ragiona davvero l’AI quando deve rispondere a una domanda

Quando un utente pone una domanda complessa, l’AI non esegue una singola ricerca lineare.

Google ha descritto questo comportamento come query expansion o query fan-out: la domanda iniziale viene scomposta in più sotto-query semantiche, eseguite in parallelo.

In pratica, la richiesta:

“Qual è il miglior ristorante di pesce a Rimini?”

viene trasformata in una serie di verifiche indipendenti, tra cui:

- identificazione delle entità rilevanti (ristoranti, chef, località)

- analisi delle recensioni aggregate e della loro affidabilità

- coerenza tra sito web, profilo Google Business e fonti esterne

- presenza di dati strutturati leggibili e verificabili

- segnali di esperienza e autorevolezza nel tempo

L’AI non “legge” semplicemente il tuo sito: correla dati provenienti da più fonti e valuta se convergono verso la stessa entità e la stessa narrazione.

Un sito che comunica informazioni vaghe o non verificabili può anche avere ottimi testi, ma viene escluso perché non fornisce abbastanza segnali di conferma.

Un sito che invece presenta dati strutturati coerenti, collegamenti esterni attendibili e segnali E-E-A-T chiari, riduce l’ambiguità per il modello generativo.

In questo senso, l’ottimizzazione per la GEO non riguarda solo “cosa scrivi”, ma quanto rendi facile all’AI verificare che ciò che scrivi sia vero.

I diversi segnali vengono aggregati, pesati e valutati attraverso sistemi di ranking basati su modelli di machine learning, che stimano la probabilità che una pagina soddisfi l’intento di ricerca meglio delle alternative disponibili.

Il posizionamento finale è quindi il risultato di un confronto dinamico tra segnali, contesto della query e qualità percepita rispetto agli altri risultati presenti in SERP.

Cosa devi chiedere alla tua agenzia

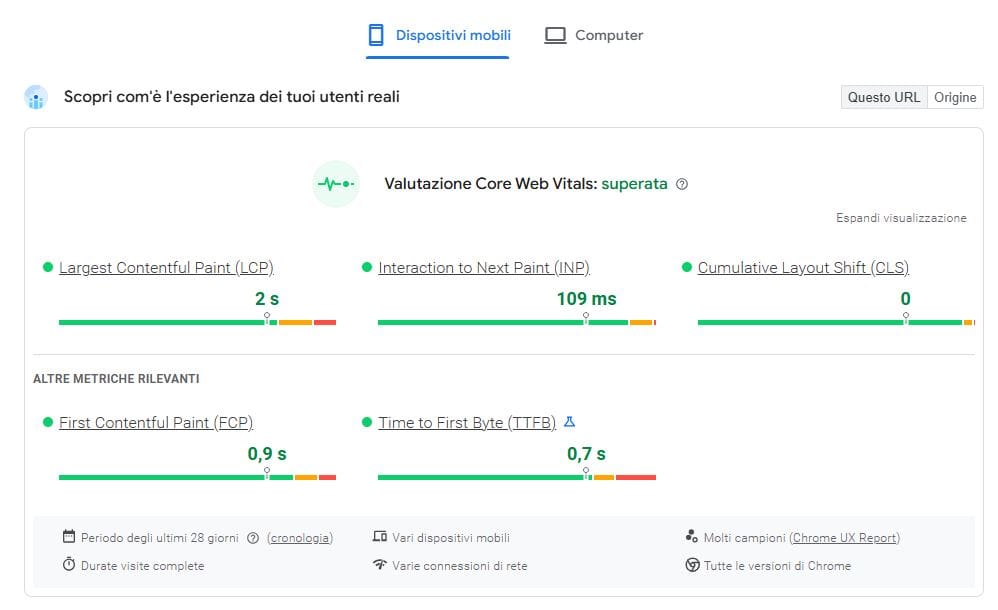

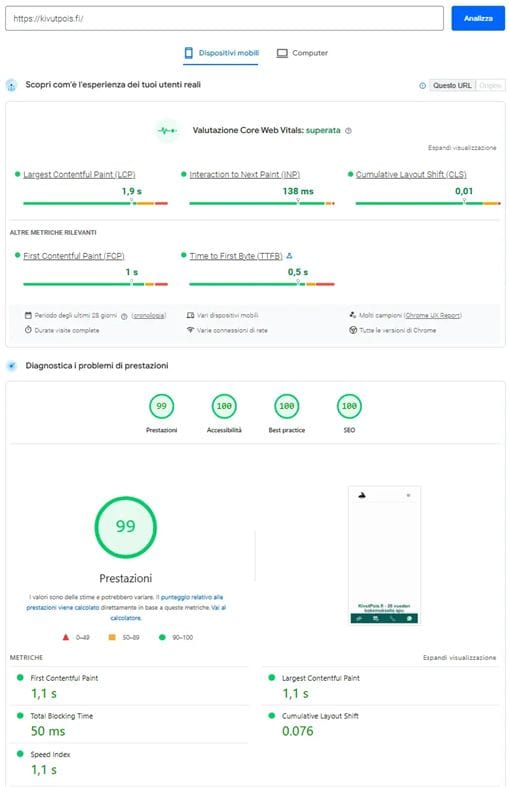

La velocità del sito: obiettivo 90+

Un punteggio sopra 90 su PageSpeed non garantisce il ranking, ma indica che le performance tecniche non stanno limitando il potenziale del sito. Se chi ti ha fatto il sito non ti mostrato le metriche potrebbe esserci qualche problema.

Vale la pena sapere che secondo un'analisi condotta su oltre 60.000 risultati di ricerca, i primi dieci risultati di Google hanno in media un punteggio intorno a 78 — e meno del 15% supera quota 90. Questo non significa che 90 non sia necessario: significa che chi arriva a 90+ ha già un vantaggio concreto sulla maggior parte della concorrenza.

Un esempio sono le metriche di un sito creato da noi per kivutpois.fi

Risparmiare non è sempre risparmio

Se risparmi sull'hosting e metti il sito su un server poco performante, risparmierai un centinaio di euro all'anno — ma se poi questo non passa i Core Web Vitals, le performance possono limitare il potenziale di visibilità rispetto a concorrenti tecnicamente più solidi.

Il risparmio si trasforma in un costo nascosto molto più alto.

Un buon sviluppatore deve cercare di raggiungere almeno:

- 90+ in Performance

- 100 in Accessibilità

- 100 in Best Practice

- 100 in SEO

Ma attenzione — e qui viene la parte che le agenzie non ti dicono quasi mai.

A differenza delle performance (che se calano di alcuni punti questo influisce notevolmente sul ranking della piattaforma), raggiungere 100 di SEO su Google PageSpeed è molto facile, ed è come dire che hai una macchina con quattro ruote che si muove. Quel risultato lo ottieni sia con una Fiat 500 sia con una Ferrari. Con i JSON-LD avanzati vedremo sempre 100 — ma la grande differenza la farà il motore che ci hai messo dentro.

Se avete bisogno di una piattaforma, chiedete all'agenzia di mostrarvi i risultati ottenuti con i suoi clienti reali.

L'effetto WOW: dove metterlo e dove no

Uno sbaglio frequente tra i meno esperti è mettere l'effetto WOW all'apertura della pagina.

La zona alta della pagina — quella che il browser mostra subito, chiamata tecnicamente ATF (Above The Fold) — deve essere semplice, semplice, semplice. Dimenticate animazioni, transizioni ed effetti scenografici in quella zona.

A meno che non siate esperti di PHP e vi costruiate da soli gli script per effetti WOW a costo zero per le performance, lasciate perdere.

Se volete comunque l'effetto WOW, mettetelo dopo la seconda sezione — e assicuratevi che il DOM venga caricato prima che parta qualsiasi animazione.

Pensate al DOM come alle fondamenta di una casa. Prima si costruiscono le fondamenta, poi si aggiungono i decori. Chi fa il contrario rischia che la casa crolli — o che Google la penalizzi.

Qui entra in gioco anche la sfida dei cookie banner e di Google Analytics 4 — entrambi molto pesanti sulle performance, capaci di portare via anche oltre 10 punti dal punteggio da soli. Se siete esperti di PHP potete gestire il caricamento in modo da limitare l'impatto. Altrimenti è una variabile da tenere ben presente quando si sceglie il plugin giusto.

Interconnessione: il tuo sito parla con il resto del mondo?

Chi ha un sito deve farsi una domanda semplice: il mio sito è collegato al mio profilo Google Business? I miei canali social sono connessi in modo che Google capisca che sono la stessa entità?

Questo si chiama Entity Linking — ed è fondamentale per la GEO.

(fonte: Cosa sono le entità su Google e perché servono alla SEO — SEOZoom.it)

Immagina di essere un medico con uno studio, un profilo LinkedIn, una pagina Facebook e un profilo Google. Se questi tre "pezzi" non si parlano tra loro, per Google sei tre persone diverse. L'Entity Linking è il filo invisibile che li unisce e dice a Google: "Sono sempre io."

Il TL;DR: non solo per i lettori, ma per le AI

Abbiamo un riassunto per chi va di fretta? I modelli generativi funzionano meglio quando incontrano contenuti strutturati, riassumibili e semanticamente espliciti. Se la tua agenzia non ti parla mai di E-E-A-T, potrebbe non essere la migliore soluzione.

Il TL;DR — “Too Long; Didn’t Read” — è una sintesi chiara dei punti principali della pagina.

Non è solo un riassunto per il lettore: è un modo per rendere esplicito il tema centrale del contenuto anche a livello strutturale.

I modelli generativi lavorano meglio quando trovano informazioni organizzate e sintetizzabili. Una sezione di sintesi aiuta proprio in questo.

Ma attenzione — non basta scrivere "TL;DR" e sperare che funzioni. Se il contenuto è nel codice HTML, può essere analizzato anche se non è visibile graficamente. L’importante è che non sia bloccato a livello di crawling.

Un piccolo esempio tecnico di come si struttura:

<aside data-ai-summary="true"><p>

<strong class="ai-tldr-label">TL;DR:</strong>

Il tuo riassunto qui.</p></aside>

Con un CSS dedicato la sezione può essere resa meno invasiva per il lettore, mantenendo però una struttura chiara e accessibile a livello di codice. In questo articolo, per esempio, ce ne sono cinque — e probabilmente non li avete notati.

Naturalmente per ottimizzare i risultati al massimo vorremo anche inserire un abstract nel nostro JSON-LD, riportando lo stesso contenuto che abbiamo scritto nel TL;DR:

json{

"@context": "https://schema.org",

"@type": "Article",

"abstract": "Il tuo TL;DR qui — la stessa sintesi che hai scritto nell'HTML, riformulata per essere estratta direttamente dai modelli generativi."

}

In questo modo il contenuto risulta più facilmente interpretabile sia per i sistemi di parsing tradizionali sia per modelli generativi attuali e futuri. Nell'HTML tramite gli attributi data-ai-*, e nel codice strutturato tramite JSON-LD.

E-E-A-T: i quattro pilastri della fiducia

Come spiegato in precedenza, Google utilizza linee guida basate su Experience, Expertise, Authoritativeness e Trustworthiness. Molti sistemi generativi tendono a riflettere logiche simili quando devono stimare l’affidabilità di una fonte.

| Lettera | Significato | Cosa serve in pratica (AI Signal) |

|---|---|---|

| E | Experience — Esperienza | Recensioni vere, case study, testimonianze dirette |

| E | Expertise — Competenza | Certificazioni, diplomi, premi verificabili |

| A | Authoritativeness — Autorevolezza | Citazioni da altri esperti, articoli pubblicati, conferenze |

| T | Trustworthiness — Fiducia | HTTPS, privacy policy chiara, contatti reali e verificabili |

Se il tuo sito non comunica chiaramente questi quattro elementi, partirà svantaggiato rispetto a chi li rende espliciti e verificabili.

L'errore più comune? Pensare che basti scrivere "Esperti dal 1990" sul sito. Non funziona più così. Devi dimostrarlo — con dati strutturati, collegamenti a fonti esterne, recensioni verificate e contenuti che provano la tua competenza sul campo.

È come presentarsi a un colloquio di lavoro dicendo "sono bravo" senza portare il curriculum. Il selezionatore — che sia un essere umano o un'AI — vuole segnali verificabili, coerenti e confrontabili, non le promesse.

Deep Tech: dalla SEO alla Generative Engine Optimization

Un punteggio perfetto su Lighthouse è solo il punto di partenza. La vera GEO richiede architettura, dati e strategia.

In questa sezione entro nel dettaglio tecnico: JSON-LD avanzati per il Knowledge Graph, attributi AI personalizzati, server-side tracking per GA4, parametri chiave da monitorare, strategie editoriali realistiche e una checklist finale in 10 punti per capire subito dove ti trovi.

Colleghi, parliamoci chiaramente

Nel 2026 un punteggio SEO del 100% su Lighthouse è un prerequisito tecnico, non un indicatore di strategia o posizionamento reale.

Se la nostra strategia si limita ancora ai tag H1 e H2, avremo molte meno possibilità di posizionarci nel ranking della serp.

Dai tag alle relazioni: dati strutturati oltre lo standard

Per dominare la ricerca generativa, non basta dichiarare "cosa fa" la piattaforma. Occorre definire la sua identità come entità interconnessa. Non possiamo limitarci allo schema Organization di base. Dovete tessere una rete di relazioni E-E-A-T che Google possa mappare nel suo Knowledge Graph.

Ecco un esempio di JSON-LD avanzato per collegare un professionista, la sua formazione e la sua rete di fiducia — in modo che l'AI non abbia dubbi sull'autorevolezza:

json{

"@context": "https://schema.org",

"@graph": [

{

"@type": "Person",

"@id": "https://tuosito.it/#person",

"name": "Nome Professionista",

"jobTitle": "Specialista in [Settore]",

"alumniOf": {

"@type": "EducationalOrganization",

"name": "Nome Università o Ente Certificatore"

},

"knowsAbout": ["Competenza A", "Competenza B", "Competenza C"],

"sameAs": [

"https://www.linkedin.com/in/profilo",

"https://twitter.com/profilo"],

"colleague": [

{

"@type": "Person",

"name": "Nome Collaboratore",

"sameAs": "https://sito-partner.com"

}

],

"mainEntityOfPage": "ID_GOOGLE_BUSINESS_PROFILE"}

]

}

(fonte: JSON-LD, AEO e GEO: siti web comprensibili alle AI — HT&T)

JSON-LD e il file llms.txt

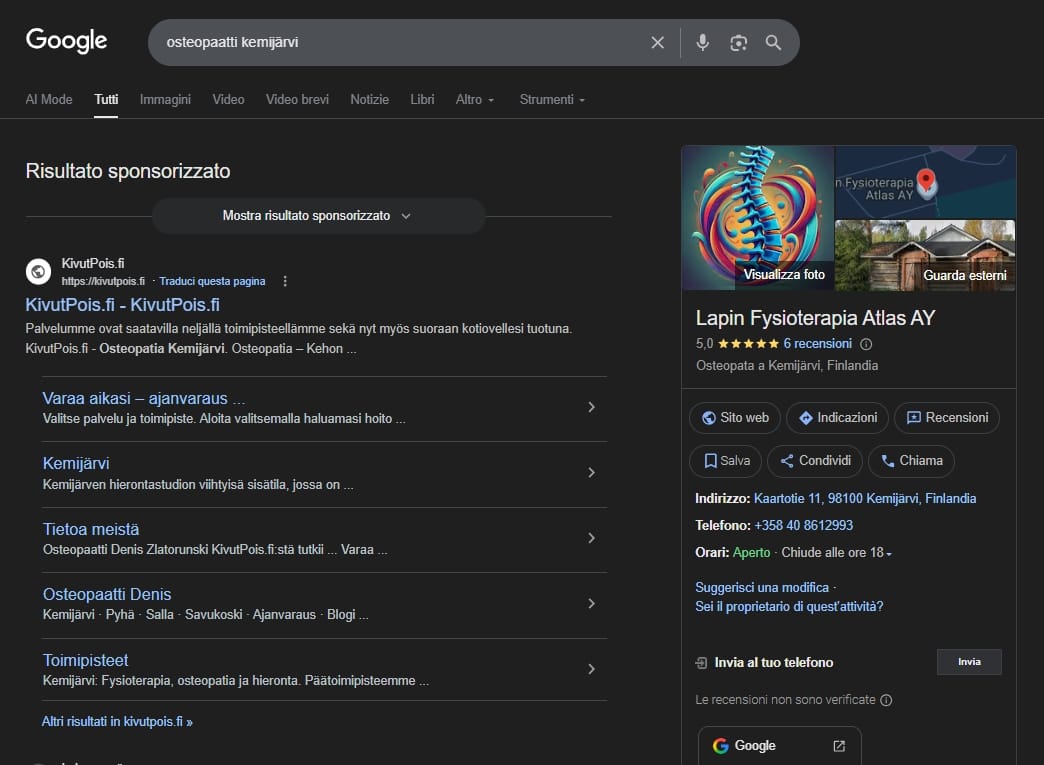

Una cosa che mi ha dato grande soddisfazione è stata la ricostruzione del sito di kivutpois.fi. Ne parlo in questa pagina.

Dopo solo 12 ore dalla pubblicazione ho visto le pagine indicizzate su Google — cosa che non sempre accade — ma la cosa che mi ha veramente caricato è stata vedere come, nel giro di una settimana, i dati crescevano. E invece del solito link ho iniziato a vedere anche i dati strutturati.

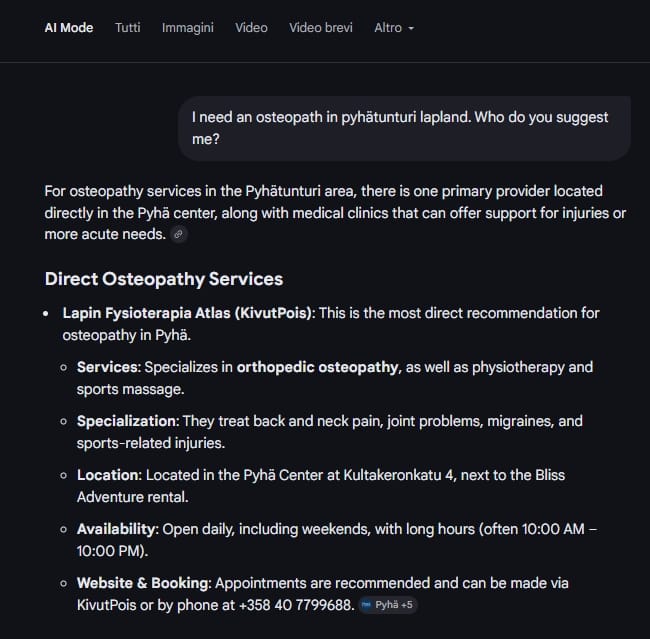

Visto i risultati positivi ho voluto fare un test per le AI per capire se il mio lavoro aveva funzionato.

Ho fatto la tipica domanda che farebbe una persona: "Sono in Lapponia vicino Kemijärvi e ho bisogno di un osteopata. Da chi mi consigli di andare?"

La prima settimana vedevo gli stessi link di sempre, ma dopo tre settimane kivutpois.fi era al primo posto nei suggerimenti insieme a Lapin Fysioterapia Atlas Ay, che è la ditta di kivutpois.fi.

Ora kivutpois.fi è primo nei suggerimenti delle ricerche AI anche in altre località turistiche come ad esempio, la località sciistica di Pyhätunturi dove la Lapin Fysioterapia Atlas ha una clinica.

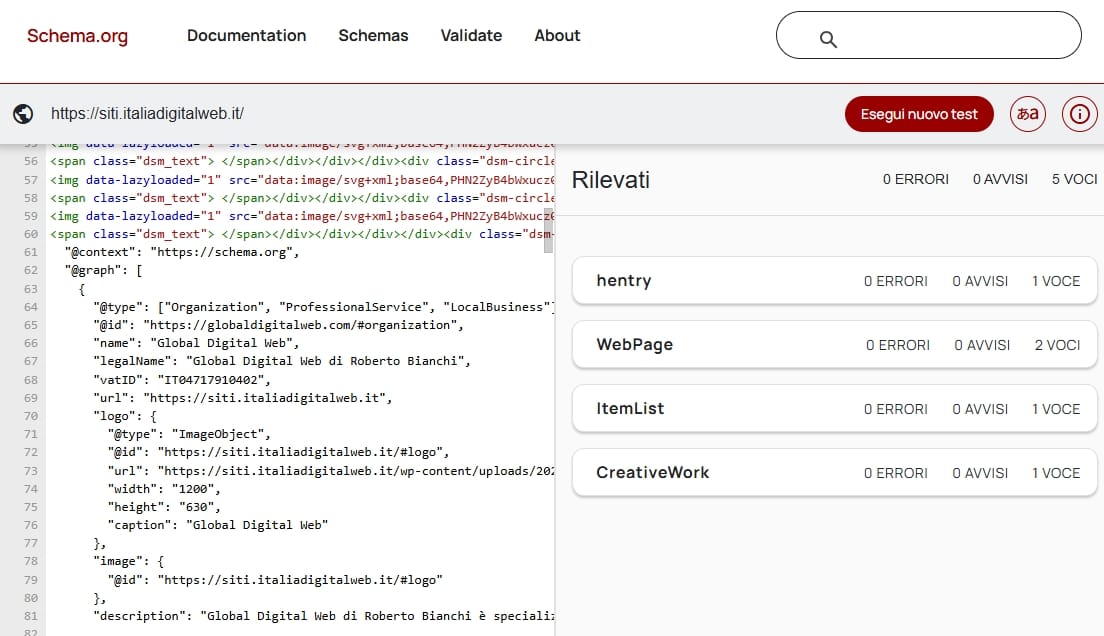

A quel punto ho fatto una domanda diversa. Ho chiesto: "Che mi dici della pagina siti.italiadigitalweb.it? Quali JSON-LD e data-ai vedi su quella pagina?"

E lì è iniziato lo stress. Immancabilmente la risposta era: "Non vedo alcun JSON-LD nella pagina e nemmeno data-ai".

Le ho provate tutte — e la frustrazione la lascio immaginare. Ma, scava scava, alla fine ho capito da cosa dipende e lo condivido qui.

Mentre lavoravo sui grafi JSON-LD per renderli più completi e avanzati, mi sono reso conto di un problema che molte AI hanno ancora oggi — e che ti manda completamente fuori strada se non lo capisci.

Quando verifico gli schema su validator.schema.org e sul test Rich Results di Google, è tutto corretto. Se controllo la source della pagina, i dati strutturati sono lì: nell'head, dove devono essere, scritti correttamente e con:

<script type="application/ld+json"> { "@context": "https://schema.org", "@graph": [ {

Quindi il JSON-LD c'è. Funziona. È scritto giusto.

Ma allora il JSON-LD non serve per la GEO?

No. Serve eccome — ma bisogna capire una distinzione.

Perché se chiedo a Gemini, Grok o ChatGPT quali dati strutturati vedono nella pagina, la risposta è quasi sempre: "Non vedo JSON-LD"?

Il problema non è nei dati, ma in come funzionano le chat AI.

Se chiedi dove andare, cosa fare o un consiglio, le AI si appoggiano a Google o a Bing e grazie a questi recuperano parte dei dati strutturati estratti dai crawler. Per questo ti rispondono: "vai da … il suo sito è questo…"

Diverso quando chiedi di controllare direttamente una pagina e gli fai fare un fetch. Quando leggono una pagina, tagliano tutto quello che pesa — script, style, tutto ciò che non è testo puro — per risparmiare token. Il JSON-LD sparisce prima ancora di essere letto.

Non è un bug: è proprio una scelta.

La chat che usi per fare i test non legge gli script. I crawler che alimentano quelle stesse AI sì.

OAI-SearchBot, Bingbot sono bot che leggono il JSON-LD per intero e lo usano esattamente per quello per cui è stato pensato: capire chi sei, cosa fai, dove sei.

Molti si preoccupano principalmente che i dati siano validati da Google, ma anche Bing conta moltissimo — molto più di quanto si pensi: SearchGPT, la ricerca web integrata in ChatGPT, si appoggia al suo indice. Se Bing ti vede strutturato bene, le tue informazioni entrano nelle risposte di ChatGPT e Copilot.

Nel tempo, quei dati potrebbero contribuire ad addestrare i modelli. Non lo vedi subito — ma restano lì e lavorano.

(Fonte: https://help.openai.com/en/articles/10093903-chatgpt-search-for-enterprise-and-edu) Il

JSON-LD parla ai crawler — e attraverso loro alle AI, nel tempo. Il testo visibile è quello che l'AI legge quando fa scraping in tempo reale. Servono entrambi — per motivi diversi.

Il file llms.txt

C'è poi uno strumento più recente, pensato per parlare direttamente alle AI.

Si chiama llms.txt e va posizionato nella root del sito, come il robots.txt.

È un file in formato Markdown scritto appositamente per essere letto dai Large Language Models — non dai motori di ricerca tradizionali, ma direttamente dalle AI.

Alcuni plugin SEO hanno iniziato a generarlo in automatico. Nella maggior parte dei casi il risultato è un file generico e inutile — praticamente non serve a niente: elenca le pagine del sito e poco altro.

Scritto a mano da chi sa cosa sta facendo, diventa invece qualcosa di diverso: il posto dove metti le informazioni su di te nel modo più diretto possibile, senza aspettare che l'AI le deduca da Google o da Bing.

Quando qualcuno chiede informazioni su di te, l'AI ha già una fonte diretta da cui partire — senza dover indovinare.

I parametri chiave da monitorare

Per misurare l'efficacia di un'architettura AI-Ready, questi sono i dati che contano davvero:

- Dominanza Entità Numero di Rich Results validati rispetto al traffico organico.

- Core Web Vitals (esperienza utente reale) Confronto tra LCP (caricamento) e INP (reattività) degli utenti reali — non del laboratorio.

- Copertura Semantica Impressioni per query a risposta diretta — le cosiddette Zero-Click Searches.

Strategie concrete: cosa funziona davvero

Siamo franchi: nessun miracolo, solo strategia. Chi promette risultati immediati non è qualcuno di cui fidarsi. Per questo scegliamo la trasparenza.

Un sito senza piano editoriale non può sopravvivere solo con le configurazioni SEO e GEO iniziali. Nel momento in cui i concorrenti inizieranno ad applicare le stesse strategie, chi non aggiorna costantemente i propri contenuti è destinato a scivolare in seconda pagina — che equivale a zero. La pubblicazione costante e di qualità è l'unica strategia sostenibile.

(fonte: GEO: Generative Engine Optimization oltre la SEO — SEOLeader.digital)

Al riguardo è interessante notare come sui social abbiano iniziato a comparire meme e jingle che promettono di portare un sito nelle prime posizioni tra le AI con pochi clic.

Proprio qualche giorno fa Diletta Beligotti, mia collaboratrice ed esperta Social Media Manager, mi ha scritto:

"Ciao Roberto, sto monitorando le adv delle agency su Facebook e guarda cosa sta uscendo. Stanno iniziando a vendere il posizionamento sulle AI alle aziende."

La mia risposta immediata è stata:

"Sí, ma il modo in cui lo raccontano nella pubblicità è pura fuffa."

Per essere davvero menzionati dalle intelligenze artificiali c'è tanto, tantissimo lavoro dietro.

Invito quindi a prestare molta, ma molta attenzione a queste false promesse, che realisticamente non sono realizzabili nel modo in cui vengono pubblicizzate.

Spesso si tratta di annunci acchiappaclick con informazioni vaghe o fuorvianti, come:

"La mia piccola impresa ottiene XX nuovi clienti al giorno grazie a ChatGPT", accompagnate dalla promessa di risultati simili con pochi clic.

State lontani da queste promesse — purtroppo spesso truffaldine — che non hanno nulla a che vedere con il modo in cui si può davvero essere trovati e utilizzati dalle intelligenze artificiali.

Se invece volete investire in una strategia seria per essere trovati, suggeriti e indicizzati dalle AI, qui sotto vi spiego in cosa consiste e come, solo attraverso un lavoro strutturato e costante, questo obiettivo possa essere realmente raggiunto.

Piano editoriale e contenuti di qualità

La base è sempre la stessa: una piattaforma ben realizzata, veloce, tecnicamente solida e strutturata con dati strutturati avanzati che aiutino i motori di ricerca e le AI a comprendere chiaramente contenuti, entità e relazioni. Tutto questo contribuisce a rafforzare la percezione di autorevolezza e affidabilità del progetto.

Ma questa è solo la base.

Una piattaforma, anche ben sviluppata, se contiene una sola pagina (o una decina) e testi scritti unicamente per coprire keyword strategiche, difficilmente verrà presa in seria considerazione.

Le pagine devono raccontare qualcosa di utile. Devono offrire valore reale, rispondere a domande concrete, invogliare gli utenti a tornare. Devono essere vive e dinamiche. Un semplice “sito vetrina”, per quanto ben fatto, raramente riuscirà a diventare un punto di riferimento.

Chi è davvero intenzionato a emergere nel panorama dei servizi locali avrà investito in:

- un sito ricco di dati strutturati coerenti e ben implementati;

- contenuti in cui ogni pagina contribuisce a rafforzare l’autorevolezza del proprietario;

- un utilizzo intelligente di attributi e markup che facilitino l’interpretazione da parte delle AI.

I dati, devono essere incrociabili e verificabili. La coerenza tra contenuto, struttura tecnica e presenza online è fondamentale.

A questo punto si può dire che gran parte del lavoro è fatto. Dopo alcune settimane o mesi, il sito potrà iniziare a essere menzionato dalle AI e a migliorare il proprio posizionamento per ricerche specifiche.

Ma c’è un aspetto cruciale: senza manutenzione e aggiornamento costante, l’autorità conquistata può diminuire rapidamente.

Ed è qui che entra in gioco il piano editoriale.

Non si tratta di pubblicare articoli casuali o contenuti scritti solo per intercettare determinate keyword.

Si tratta di offrire un vero servizio al pubblico.

Un piano editoriale efficace nasce dalle domande reali delle persone, dai dubbi che emergono nel quotidiano, dai problemi concreti che cercano soluzione.

Se sei un professionista in ambito medico, ad esempio, puoi analizzare con regolarità come prevenire, gestire o riconoscere determinati disturbi.

Qualunque sia il tuo settore, la chiave è usare la tua esperienza per aiutare e aiutare davvero.

Questo è il vero segreto!

Molti commettono l’errore di concentrarsi esclusivamente sull’acquisizione di autorevolezza tecnica o link esterni, dimenticando che una piattaforma di qualità deve prima di tutto essere utile a chi si trova in difficoltà.

Per un momento, mettiamo da parte algoritmi e parole chiave.

Mettiamo al centro le persone.

Quando l’attenzione è rivolta agli esseri umani, gli articoli diventano naturalmente più utili, più condivisibili, più autorevoli. E questo, nel tempo, aiuta la piattaforma a mantenere e rafforzare la propria posizione nella SERP.

Naturalmente, l’esperto dovrà concentrarsi sulla produzione di contenuti realmente validi.

Sarà poi compito dello sviluppatore o del team tecnico integrarli correttamente nella piattaforma, strutturarli in modo chiaro, arricchirli con i dati strutturati necessari e renderli facilmente interpretabili dalle AI.

Strategia Base: quattro contenuti al mese

Cosa include:

- SEO semantica avanzata su ogni contenuto

- Dati strutturati personalizzati (JSON-LD e Schema.org)

- GEO: ottimizzazione per AI (attributi data-ai-*, TL;DR, contesto)

Indicizzazione generalmente rapida nei progetti implementati correttamente (i tempi dipendono dal dominio e dal settore)

E-E-A-T: i quattro pilastri della fiducia

Come spiegato in precedenza, Google utilizza linee guida basate su Experience, Expertise, Authoritativeness e Trustworthiness. Molti sistemi generativi tendono a riflettere logiche simili quando devono stimare l’affidabilità di una fonte.

| Lettera | Significato | Cosa serve in pratica (AI Signal) |

|---|---|---|

| E | Experience — Esperienza | Recensioni vere, case study, testimonianze dirette |

| E | Expertise — Competenza | Certificazioni, diplomi, premi verificabili |

| A | Authoritativeness — Autorevolezza | Citazioni da altri esperti, articoli pubblicati, conferenze |

| T | Trustworthiness — Fiducia | HTTPS, privacy policy chiara, contatti reali e verificabili |

Se il tuo sito non comunica chiaramente questi quattro elementi, partirà svantaggiato rispetto a chi li rende espliciti e verificabili.

L'errore più comune? Pensare che basti scrivere "Esperti dal 1990" sul sito. Non funziona più così. Devi dimostrarlo — con dati strutturati, collegamenti a fonti esterne, recensioni verificate e contenuti che provano la tua competenza sul campo.

È come presentarsi a un colloquio di lavoro dicendo "sono bravo" senza portare il curriculum. Il selezionatore — che sia un essere umano o un'AI — vuole segnali verificabili, coerenti e confrontabili, non le promesse.

Strategia Professional: dieci contenuti al mese

Cosa include:

- Tutto quanto nella Strategia Base

- Report mensile su posizionamenti e performance

- Maggiore velocità di indicizzazione

- Copertura semantica più ampia

Tempi realistici MINIMI per possibile visibilità nei sistemi generativi:

| Situazione | Primi risultati | Posizionamento stabile | Citazioni AI |

| Dominio nuovo (< 1 anno) | 2-3 mesi | 4-8 mesi | 3-4 mesi |

| Dominio esistente (> 1 anno) | 1-2 settimane | 4-6 mesi | Prima dei 2 mesi |

Strategia Business: venti contenuti al mese

Cosa include:

- Tutto quanto nella Strategia Professional

- Report mensile dettagliato + call strategica mensile

- Monitoraggio competitor avanzato

- Ottimizzazione continua basata sui dati

Importante: Questo approccio è complementare — non sostituisce le campagne Google Ads, che restano consigliate per chi ha bisogno di risultati immediati o non ha ancora un piano editoriale attivo.

Cosa serve davvero per farlo funzionare

La strategia SEO/GEO richiede un investimento serio su tre fronti:

- Un team tecnico per l'ottimizzazione (SEO, dati strutturati, GEO)

- Un esperto del settore che produca articoli di qualità

- Costanza: almeno 4 articoli al mese, ogni mese, per almeno 6-12 mesi

Non promettiamo miracoli — ma questa strategia funziona. Se hai un piano editoriale solido e pubblichi con costanza, col tempo potrai competere stabilmente per le prime posizioni nella SERP e aumentare le probabilità di essere considerato una fonte autorevole anche nei sistemi generativi.

Sette errori comuni da evitare

1) Pensare che un plugin SEO basti

Yoast SEO e RankMath sono ottimi strumenti, ma I plugin SEO coprono la parte tecnica di base. La differenza vera la fa l’architettura del sito e la strategia dietro ai contenuti.

2) Credere che la velocità sia tutto

Un sito veloce è fondamentale, ma deve comunicare chiaramente chi sei, cosa fai e perché sei affidabile. Oggi chi non struttura bene entità e contenuti parte svantaggiato rispetto a chi lo fa in modo strategico.

3) Non collegare le proprietà digitali

Sito web, Google Business Profile, social media e recensioni devono essere collegati tra loro con dati strutturati. Se le AI vedono entità separate, non capiranno che sei la stessa persona o azienda.

4) Pubblicare contenuti generici

I modelli generativi funzionano meglio quando trovano contenuti strutturati, riassumibili e semanticamente espliciti. Un contenuto generico senza esperienza reale difficilmente genera segnali di autorevolezza nel medio periodo. Un case study dettagliato con dati tecnici e risultati misurati vale oro.

5) Ignorare i Core Web Vitals reali

Molti si concentrano solo sui test di laboratorio (Lighthouse). Ma Google guarda i dati degli utenti reali (CrUX). Se il tuo sito è veloce nei test ma lento per gli utenti veri, hai un problema concreto.

6) Non misurare i risultati

Se non monitori le impressioni per query semantiche, i rich results e le citazioni AI, stai volando alla cieca.

7) Aspettarsi risultati immediati

La SEO/GEO è una maratona, non uno sprint. Chi ti promette la prima pagina in due settimane ti sta mentendo — a meno che non stia parlando di Google Ads, che è tutta un'altra cosa.

Checklist: 10 cose da verificare sulla tua piattaforma

- Velocità reale (non solo il test): vai su PageSpeed Insights e controlla il punteggio nella sezione "Dati sull'origine" — dati utenti reali. Se è sotto 75, hai un problema serio.

- Dati strutturati presenti: vai su schema.org/validator e inserisci l'URL della tua home page. Se non vedi JSON-LD o markup strutturato, il tuo sito non sta fornendo informazioni esplicite alle AI — e sta lasciando tutto all’interpretazione automatica.

- Collegamento Google Business: il tuo sito ha un link al tuo profilo Google Business? Le recensioni di Google appaiono sul sito?

Se no, stai perdendo punti E-E-A-T. - TL;DR sulle pagine importanti: le tue pagine principali hanno un riassunto strutturato? Una sintesi chiara aumenta le probabilità che le informazioni vengano estratte correttamente nei sistemi generativi.

- Core Web Vitals: in Google Search Console vai su "Esperienza" → "Core Web Vitals". Se più del 25% delle URL ha problemi, devi intervenire.

- Presenza mobile: più del 60% delle ricerche a livello mondiale avviene da mobile. Apri il tuo sito su smartphone e cronometra: si carica in meno di 2 secondi? È navigabile con il pollice?

- HTTPS: il tuo sito ha il lucchetto nella barra degli indirizzi? Se è ancora HTTP, il sito viene considerato meno sicuro e parte svantaggiato rispetto a chi utilizza HTTPS.

- Segnali E-E-A-T: sul tuo sito c'è una biografia dettagliata? Ci sono certificazioni, premi, esperienze verificabili? O solo "siamo i migliori dal 1990"?

- Collegamenti esterni: il tuo sito ha link ai tuoi profili social? A fonti autorevoli? I link aiutano le AI a mappare la tua rete di fiducia.

- Test diretto con un'AI: vai su ChatGPT, Perplexity o Claude e chiedi: "Parlami di [nome tua azienda]". Se l'AI non ti conosce o dà informazioni sbagliate, il tuo sito non è ottimizzato per le AI.

FAQ: le domande più frequenti sulla GEO

Quanto tempo ci vuole per vedere risultati con la GEO?

Dipende dall'età del dominio e dalla costanza.

Per un dominio nuovo aspettati minimo 3-4 mesi per i primi risultati e 6-12 mesi per un posizionamento stabile.

Per un dominio esistente con buona storia, i risultati possono arrivare anche prima, con possibili citazioni nei sistemi generativi nel medio periodo, se il progetto è strutturato correttamente e il settore lo consente.

La chiave è sempre la stessa: almeno 4 contenuti ottimizzati al mese, ogni mese.

Il mio sito WordPress è già ottimizzato per le AI?

Quasi certamente no.

Yoast e RankMath fanno solo la SEO di base: titoli, meta description, sitemap. Non implementano JSON-LD multi-entità, non creano attributi AI personalizzati, non collegano il sito al Google Business Profile in modo strutturato. Sono la base necessaria, ma non sufficiente per la GEO.

Devo rifare completamente il sito o posso aggiornarlo?

Nella maggior parte dei casi puoi aggiornare il sito esistente.

Serve aggiungere: dati strutturati JSON-LD avanzati, attributi AI nelle sezioni chiave, collegamenti verificati alle tue proprietà digitali, contenuti ottimizzati per E-E-A-T.

Un buon sviluppatore può implementare tutto questo sul tuo WordPress esistente

senza stravolgere il design.

Cos'è il JSON-LD e perché è importante?

I dati strutturati non servono a “forzare” il ranking, ma aiutano il motore a capire con precisione chi sei, cosa fai e come le informazioni sono collegate tra loro.

È la differenza tra dire “sono bravo” e presentare un certificato verificabile.

Le AI possono danneggiare il mio business se non ottimizzo?

Più che danneggiarti, rischi di non essere preso in considerazione quando l’utente fa una domanda nel tuo settore.

Quando un utente chiederà "Dove trovo un [tuo servizio] a [tua città]?"

l'AI risponderà consigliando i tuoi concorrenti che hanno ottimizzato.

È come avere un negozio in una strada dove Google Maps non ti segna: esisti, ma nessuno ti trova.

Quanto costa implementare la GEO rispetto alla SEO tradizionale?

La GEO richiede competenze più avanzate, quindi sì, costa di più.

Un'ottimizzazione SEO base può costare 300-500€ una tantum.

Un'implementazione GEO completa — JSON-LD multi-entità, attributi AI,

collegamenti verificati, ottimizzazione contenuti — parte da 1.500-3.000€ come setup iniziale, più un costo mensile per la creazione e ottimizzazione dei contenuti

(750-2.200€ al mese a seconda del volume).

I risultati però sono molto più duraturi e difficili da replicare dai competitor.

Una nota finale

Naturalmente ci sarebbe materiale per scrivere interi libri sull'argomento. Ho pensato però che in italiano, ad oggi — Marzo 2026 — ci sia ancora poco o nulla di organico su questi temi. Per questo ho scritto questa guida, utile sia a chi ha un sito o deve farselo fare, sia a chi i siti li crea professionalmente.

Spero sia stato utile.

About the Author

With more than three decades in digital tech and education, Roberto Bianchi is dedicated to breaking down complex technological concepts into clear, actionable insights.

His global journey — from Finland to the U.S. and Kenya — has shaped a uniquely human-centered approach to technology, making it accessible and practical for everyone.

Key expertise:

- SEO and Generative Engine Optimization

- Web development

- Digital marketing

- Training and mentoring

- Content creation

Roberto is the founder of Global Digital Web, focused on making technology understandable and useful in everyday life.